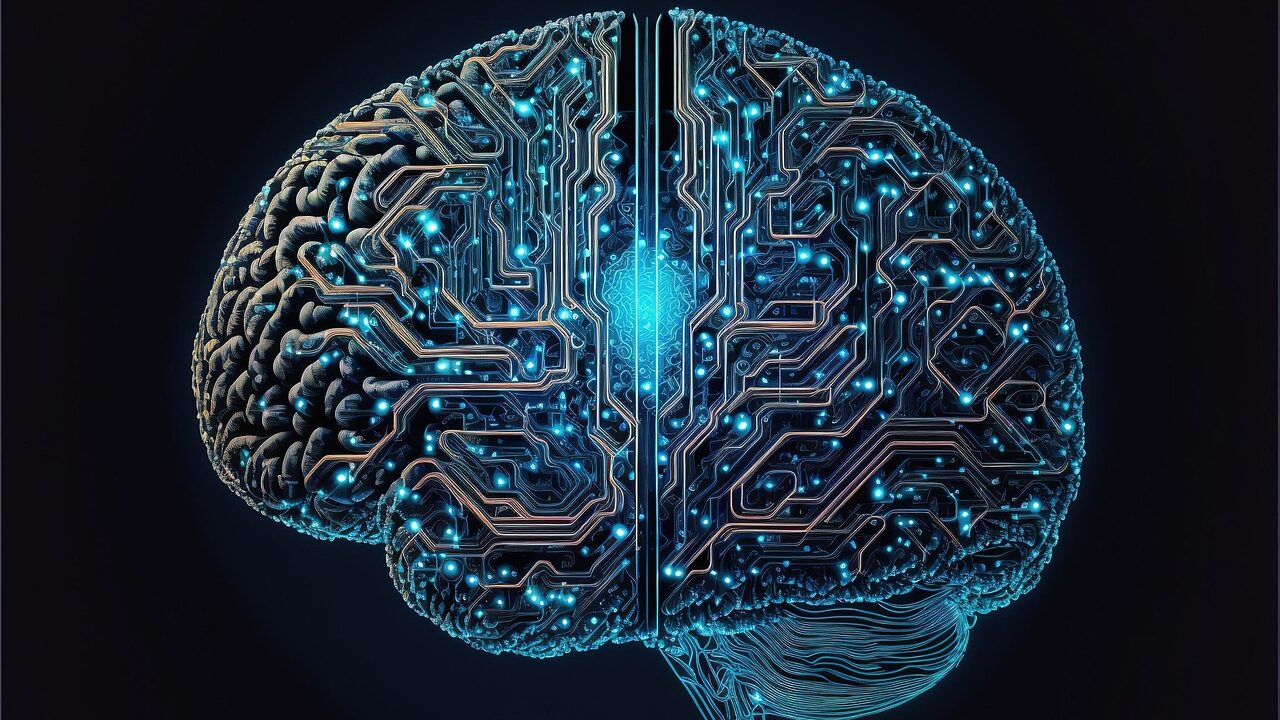

En el desarrollo de la inteligencia artificial, dos factores resultan fundamentales: la veracidad y la explicabilidad. Aunque mucho se habla de los sesgos en los datos, es igualmente importante considerar los sesgos algorítmicos que los modelos, especialmente las redes neuronales, pueden introducir.

Los sistemas de IA no solo aprenden de los datos que les proporcionamos; también reflejan decisiones implícitas en el diseño de los algoritmos. Por eso, los sesgos pueden surgir tanto del conjunto de datos como del propio modelo. En ambos casos, el impacto puede ser significativo.

Este tema es especialmente crítico cuando se trabaja con:

- IA generativa

- Sistemas expertos

- Sistemas autónomos

En estos contextos, un sesgo mal gestionado puede llevar a decisiones erróneas, injustas o incluso peligrosas.

Últimamente veo muchas empresas depositando una confianza ciega en los sistemas de inteligencia artificial. Algunas lo hacen por ignorancia, otras por arrogancia, y otras simplemente por seguir una tendencia.

Pero debemos ser conscientes de que, actualmente, la mayoría de las IAs son auténticas cajas negras, donde hay dos sesgos muy importantes::

- Sesgos algoritmicos: No conocemos con claridad los algoritmos que se han utilizado, la mayoría de empresas no proporcionan información.

- Sesgos de datos: Tampoco sabemos con certeza con qué datos fueron entrenadas, es decir, si son legales, ilegales, publicas, privadas, estaban manipuladas, o se introdujen sesgos involuntarios o voluntarios.

La inteligencia artificial tiene un enorme potencial, pero su adopción sin un enfoque crítico y ético puede tener consecuencias graves. Necesitamos más transparencia, explicabilidad y responsabilidad en su desarrollo y aplicación.

Mi recomendación, se cauteloso con la IA.

#IA #AI #Sesgos #Explicabilidad #ÉticaEnIA